在這里了解當(dāng)今互聯(lián)網(wǎng)的最新動(dòng)態(tài)

在這里了解當(dāng)今

(封面由midjourney生成)

家人們,誰(shuí)懂啊……

ChatGPT還沒(méi)鬧明白,一覺(jué)醒來(lái),OpenAI又開(kāi)始搞事情了,這次直接來(lái)了個(gè)王炸:Sora。

不認(rèn)識(shí)它沒(méi)關(guān)系,簡(jiǎn)單來(lái)講,它的功能就是根據(jù)描述性的文本提示,生成高質(zhì)量的視頻內(nèi)容。你可以理解為,你把你想要的場(chǎng)景以文本的形式寫(xiě)下來(lái)給它,它就能給你生成對(duì)應(yīng)的視頻,最高能生成60秒。

我當(dāng)時(shí)聽(tīng)到這玩意兒出來(lái)的第一反應(yīng)是:厲(N)害(B)。

第二反應(yīng):好家伙,影視人要失業(yè)了。

不過(guò)這一幕,好像似曾相識(shí):

ChatGPT剛出來(lái)時(shí)第一反應(yīng):同上。第二反應(yīng):好家伙,文案人要失業(yè)了。

midjourney剛出來(lái)時(shí)第一反應(yīng):同上。第二反應(yīng):好家伙,設(shè)計(jì)師要失業(yè)了。

好嘛,合著OpenAI跟廣告行業(yè)杠上了(bushi)。

1、sora有多強(qiáng)?功能介紹

Sora模型的誕生時(shí)間是在2024年2月15日,就是春節(jié)上班前兩天。

可能是覺(jué)得CNY的余熱不夠,Sora提供話題素材了來(lái)了,就像在春節(jié)的尾巴拋下一顆炸彈,一時(shí)間大家都在討論Sora。

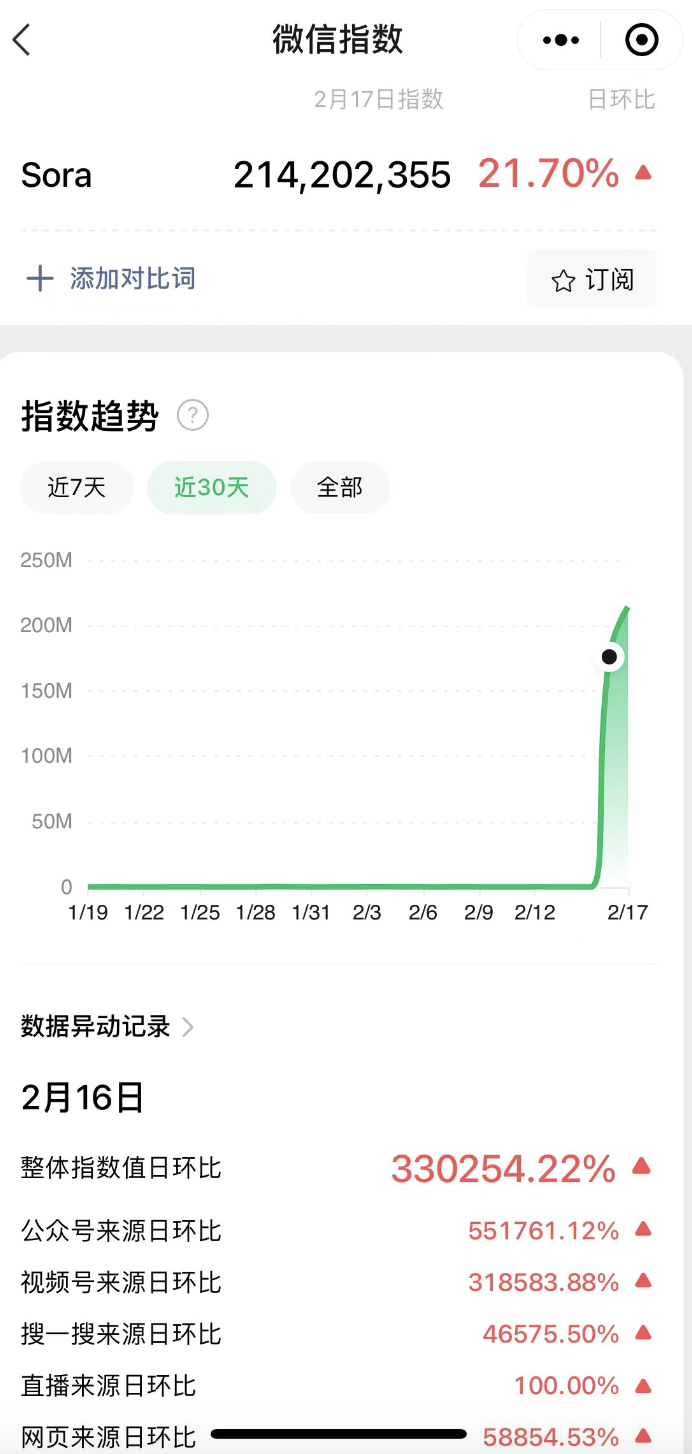

看看這暴增的搜索量,別說(shuō)簡(jiǎn)單別說(shuō)破圈層了,那是直接擊穿了地球?qū)印?/p>

能引起這么高全民關(guān)注度,Sora還真得有兩把刷子。鑒于我對(duì)它技術(shù)的認(rèn)知確實(shí)膚淺,在功能介紹這塊,我找我的AI小助手問(wèn)了問(wèn),首先,請(qǐng)它介紹一下Sora:

Q:

可以介紹一下Sora的具體情況嗎?

A:

Sora是由OpenAI開(kāi)發(fā)的一種先進(jìn)的文本到視頻生成模型。Sora模型的誕生時(shí)間是在2024年2月15日。OpenAI在這一天發(fā)布了Sora,這一模型能夠根據(jù)用戶輸入的文本提示生成長(zhǎng)達(dá)一分鐘的高清視頻。Sora模型采用了擴(kuò)散型變換器(diffusion transformer)架構(gòu),這是一種基于深度學(xué)習(xí)的模型,能夠?qū)㈦S機(jī)噪聲逐漸轉(zhuǎn)化為有意義的圖像或視頻內(nèi)容。

Sora模型的核心優(yōu)勢(shì)在于其能夠處理和生成具有復(fù)雜動(dòng)態(tài)和空間關(guān)系的高質(zhì)量視頻,這在以往的視頻生成技術(shù)中是難以實(shí)現(xiàn)的。與傳統(tǒng)的視頻生成模型相比,Sora在多模態(tài)輸入處理、視頻連貫性、逼真度等方面展現(xiàn)出了顯著的優(yōu)勢(shì)。它可以生成具有多個(gè)角色、特定類型的運(yùn)動(dòng)以及精確的主題和背景細(xì)節(jié)的復(fù)雜場(chǎng)景。

盡管Sora模型展示了令人印象深刻的效果,OpenAI也承認(rèn)它存在一些局限性,例如可能難以準(zhǔn)確模擬復(fù)雜場(chǎng)景中的物理現(xiàn)象,可能無(wú)法理解具體的因果關(guān)系,以及可能混淆提示的空間細(xì)節(jié)等。目前,Sora模型尚未公開(kāi)使用,OpenAI正在與第三方安全測(cè)試人員共享該模型進(jìn)行紅隊(duì)測(cè)試,并在模型中包含了過(guò)濾器,以阻止暴力、色情、仇恨內(nèi)容以及特定人物的視頻輸出。此外,OpenAI還在嘗試將C2PA技術(shù)標(biāo)準(zhǔn)嵌入到Sora的輸出視頻中,以幫助鑒別視頻是否為AI深度偽造內(nèi)容。

哦,我悟了——它能夠根據(jù)用戶輸入的文本提示生成長(zhǎng)達(dá)一分鐘的高清視頻,其他技術(shù)性文字,分開(kāi)不認(rèn)識(shí),合在一起更是看不懂(扶額苦笑。

但這也夠了,畢竟你只需要知道電腦怎么用就行,不用知道它背后運(yùn)行的邏輯不是。

但是這個(gè)具體的功能,還是有點(diǎn)不太明白,于是我就接著問(wèn)了問(wèn)AI小助手,畢竟它比我懂得多:

Q:

Sora有哪些功能?

A:

OpenAI的Sora是一個(gè)文本到視頻的生成模型,它可以根據(jù)描述性的文本提示生成高質(zhì)量的視頻內(nèi)容。Sora的主要功能和特點(diǎn)包括:

1. 文本到視頻生成:Sora能夠理解自然語(yǔ)言描述,并根據(jù)這些描述生成與之相符的視頻。用戶可以提供文本提示,Sora會(huì)生成相應(yīng)的視頻場(chǎng)景。

2. 視頻時(shí)長(zhǎng)和分辨率:Sora能夠生成長(zhǎng)達(dá)60秒的高清視頻,支持不同的視頻時(shí)長(zhǎng)、分辨率和縱橫比。

3. 視頻壓縮網(wǎng)絡(luò):Sora使用了一個(gè)壓縮網(wǎng)絡(luò),將原始視頻數(shù)據(jù)降維到一個(gè)潛在空間,然后通過(guò)變換器網(wǎng)絡(luò)將潛在空間分割成時(shí)空塊,作為輸入。

4. 擴(kuò)散模型:Sora采用了基于擴(kuò)散的生成方法,從一個(gè)隨機(jī)噪聲開(kāi)始,逐步恢復(fù)出目標(biāo)視頻。這種方法在語(yǔ)言建模、計(jì)算機(jī)視覺(jué)和圖像生成等領(lǐng)域已經(jīng)顯示出顯著的擴(kuò)展性。

5. 語(yǔ)言理解:Sora能夠理解自然語(yǔ)言,并根據(jù)語(yǔ)言的語(yǔ)義和語(yǔ)法生成合理的視頻內(nèi)容。

6. 圖像和視頻編輯:Sora不僅可以基于文本提示生成視頻,還可以基于現(xiàn)有圖像或視頻進(jìn)行提示,生成與之相關(guān)的視頻,或者在其基礎(chǔ)上進(jìn)行修改或延續(xù)。

7. 模擬能力:Sora在大規(guī)模訓(xùn)練時(shí)展現(xiàn)出了一些新興能力,能夠模擬物理世界中的某些方面,如動(dòng)態(tài)相機(jī)運(yùn)動(dòng)、長(zhǎng)期一致性和對(duì)象持久性等。

8. 多模態(tài)理解:Sora能夠處理和理解多模態(tài)數(shù)據(jù),即同時(shí)處理文本、圖像和視頻信息,這使得它在生成視頻時(shí)能夠更好地理解和模擬現(xiàn)實(shí)世界。

Sora的這些功能使得它在視覺(jué)藝術(shù)、電影制作、教育、娛樂(lè)等領(lǐng)域具有廣泛的應(yīng)用潛力。然而,Sora目前仍在開(kāi)發(fā)中,存在一些局限性,例如在處理復(fù)雜物理場(chǎng)景時(shí)可能會(huì)有不準(zhǔn)確的表現(xiàn),以及在理解因果關(guān)系方面可能存在挑戰(zhàn)。OpenAI正在與專家團(tuán)隊(duì)合作,以確保模型的安全性和準(zhǔn)確性,并開(kāi)發(fā)工具來(lái)檢測(cè)和拒絕不當(dāng)?shù)妮斎搿?/p>

哦,我又悟了:原來(lái)它不僅能根據(jù)文本生成視頻,還能根據(jù)現(xiàn)有的圖像或者視頻,生成相關(guān)的視頻,或者在此基礎(chǔ)上進(jìn)行延續(xù),也就是說(shuō),它是具備內(nèi)容連貫性的。

也就是說(shuō),所有和視頻相關(guān)的行業(yè)、平臺(tái)之類的,都有可能被它顛覆。

我甚至看到有評(píng)論說(shuō):這下好了,喜歡的小說(shuō)可以自己生成影視作品了——這么一看,普通人也很有機(jī)會(huì)嘛。

2、Sora還沒(méi)用上,課程先出來(lái)了

別割了,讓本韭菜長(zhǎng)一會(huì)吧

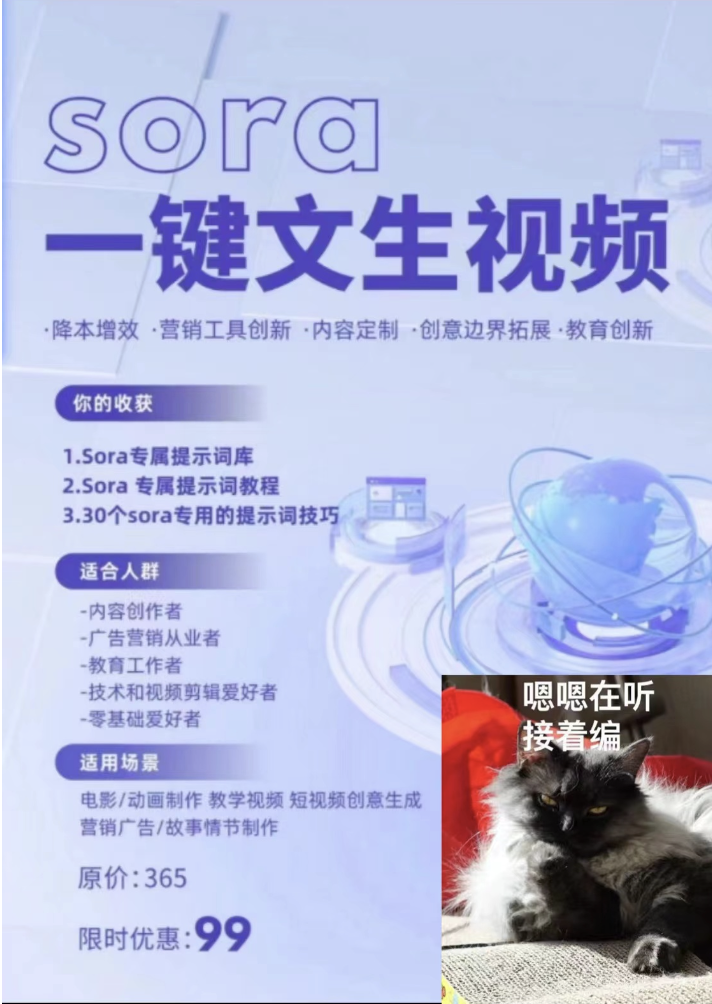

Sora出來(lái)后,也誕生了很多魔幻的段子,比如,有些人還沒(méi)用上Sora,課程大綱已經(jīng)列好了:

有沒(méi)有一種可能,它們連頁(yè)面都打不開(kāi)。

您的sora拒絕了您的訪問(wèn)

請(qǐng)稍后再試

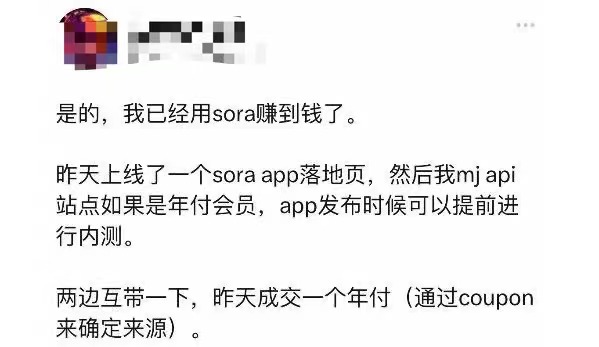

還有各種搶注域名的、做落地頁(yè)的:

圖片來(lái)源于網(wǎng)絡(luò)

不知道是不是真的在這個(gè)賽道上賺到錢(qián)了,但我看完這些搶跑選手只想說(shuō)兩點(diǎn):

這錢(qián)你們賺吧,我是賺不到一點(diǎn)兒。以及,

都別吵了,咱先用上Sora再說(shuō)吧。

3、Call back一下:

如果Sora真的行,我們?cè)摼邆淠男┠芰?lái)應(yīng)對(duì)它?

就像開(kāi)頭說(shuō)的那樣,來(lái)了個(gè)啥新技術(shù),就要傳“xx要失業(yè)了”,這話不合理,但也合理,畢竟工具總要迭代,但不是說(shuō)一來(lái)就讓你失業(yè)了,它要有個(gè)過(guò)程。

你想想,就像之前手寫(xiě)廣告文案,到電腦打字,變得只是方式,不變的是你的想法、創(chuàng)意。

那咱這Sora大概也差不多嘛,你要用文本描述,還不得人有想法才行,你沒(méi)想法,給你你也用不了。難肯定是有點(diǎn)難度的,畢竟是個(gè)全新的東西,那就慢慢摸索唄。

其實(shí)從ChatGPT到midjourney再到Sora,有一個(gè)比較核心的點(diǎn)就是:它們都依賴“文本提示”。

ChatGPT是,你要想方設(shè)法調(diào)整你的提問(wèn),不管是模擬專家也好,對(duì)提問(wèn)進(jìn)行限制也好,考驗(yàn)的是邏輯思維和文本能力;

midjourney則是要用各種提示詞,來(lái)描述場(chǎng)景,有時(shí)候意思相近的兩個(gè)詞,可能生成的圖像結(jié)果不同,這也考驗(yàn)文本能力。

咱就是說(shuō),這么一看下來(lái),做文案的朋友贏麻了,畢竟平常沒(méi)少想破腦袋想詞來(lái)著。

不過(guò),既然AI都這么發(fā)達(dá)了,那不用用它幫我解答真是說(shuō)不過(guò)去了,于是,我把這個(gè)問(wèn)題喂給了AI小助手,它告訴我:

1. 精確的文本提示:Sora模型依賴于文本提示來(lái)生成視頻內(nèi)容。因此,提供清晰、具體且詳細(xì)的描述性文本提示對(duì)于生成高質(zhì)量視頻至關(guān)重要。嘗試使用生動(dòng)的語(yǔ)言和具體的場(chǎng)景描述,以便模型能夠理解并生成符合預(yù)期的視頻。

2. 理解模型限制:了解Sora模型的局限性,例如它可能在處理復(fù)雜物理現(xiàn)象、因果關(guān)系和空間細(xì)節(jié)方面存在挑戰(zhàn)。在設(shè)計(jì)提示時(shí),盡量避免這些領(lǐng)域的復(fù)雜性,或者為模型提供足夠的上下文信息來(lái)幫助它克服這些挑戰(zhàn)。

6. 原始尺寸和時(shí)長(zhǎng)訓(xùn)練:OpenAI在訓(xùn)練Sora時(shí)選擇了原始尺寸和時(shí)長(zhǎng),這使得生成的視頻能夠更好地自定義時(shí)長(zhǎng)和尺寸。在設(shè)計(jì)提示時(shí),考慮視頻的最終用途,以便生成適合特定場(chǎng)景的視頻。

7. 利用GPT進(jìn)行提示擴(kuò)寫(xiě):在輸入提示詞時(shí),OpenAI使用了GPT模型來(lái)擴(kuò)寫(xiě)用戶的提示詞,以提高視頻生成的準(zhǔn)確性。這意味著在輸入提示時(shí),簡(jiǎn)潔明了的描述可能更有助于GPT進(jìn)行有效的擴(kuò)寫(xiě)。

3. 利用多模態(tài)輸入:略

4. 視頻壓縮網(wǎng)絡(luò)和潛空間:略

5. 利用Transformer架構(gòu):略

8. 關(guān)注模型的倫理和安全問(wèn)題:略

(復(fù)雜的技術(shù)性的東西我就不放了哈,真的很占位置就是說(shuō))

你看,新技術(shù)來(lái)了,別慌,可以關(guān)注一些最新的信息,也要讓子彈先飛一會(huì),看看到底有哪些可以幫助你的。

資訊列表